Кэш — это не просто технический термин, это невидимый двигатель, который ускоряет работу компьютеров, браузеров и серверов, снижая задержки и экономя ресурсы. Представьте, что нужная информация оказывается у вас под рукой ещё до того, как вы её попросили — именно так действует хорошо спроектированный кэш, будь то в процессоре, в дисковой подсистеме или в веб-браузере. В этой статье мы подробно разберём понятие кэш/кеш (cache), его историю, архитектуру, алгоритмы и практические приёмы, которые используют ведущие специалисты отрасли — от инженеров Intel и AMD до разработчиков ядра Linux.

История

Термин cache впервые появился в компьютерной литературе в конце 1960-х годов и быстро стал общеупотребительным. В контексте развития вычислительной техники он был введён при описании улучшений памяти для одной из моделей семейства System/360. Изначально редакторы искали ёмкое обозначение для концепции «высокоскоростного буфера» и остановились на слове cache, позже адаптированном в русскоязычной практике как кэш или кеш. С тех пор концепция и термин прошли значительную эволюцию: от аппаратных буферов в мейнфреймах до сложных иерархий уровней кэша в современных многоядерных CPU и распределённых кеш-слоёв в облачных системах.

Функционирование

Кэш — это промежуточный буфер с ускоренным доступом, хранящий копии наиболее востребованных данных из более медленных источников. Основная идея проста: предоставлять часто запрашиваемую информацию быстрее, чем считывание её из основной памяти или удалённого сервера. В результате снижается среднее время доступа и повышается общая производительность системы.

Структурно кэш состоит из множества записей (строк), каждая из которых содержит копию блока данных и идентификатор (тег), указывающий на источник в основной памяти. При обращении клиент кэша (процессор, браузер, ОС) сперва проверяет кэш. Если запись найдена — это попадание (hit), и данные возвращаются быстро. Если нет — происходит промах (miss), данные считываются из основного хранилища и помещаются в кэш.

При ограниченном объёме кэша необходимо выбирать записи для вытеснения. Для этого применяются алгоритмы вытеснения, такие как LRU, LFU и ARC. Кроме того, при записи данных в кэш реализуются различные политики синхронизации с основной памятью — write-through (сквозная запись) или write-back (отложенная запись). Также важна когерентность кэша в многопроцессорных системах — протоколы наподобие MESI/MOESI обеспечивают согласованность копий данных в разных кэшах.

Пример из повседневной практики: веб-браузер проверяет локальный дисковый кэш перед тем, как загрузить страницу с удалённого сервера — URL играет роль тега, а содержимое страницы — кэшируемые данные.

Аппаратная реализация

Кэш центрального процессора

С переходом процессоров к более высоким тактовым частотам разрыв между скоростью CPU и подсистемой памяти стал узким местом. Аппаратная кэш-память призвана сгладить этот разрыв, обеспечивая доступ к данным с задержками, близкими к тактовой частоте процессора.

Современные процессоры оснащаются несколькими уровнями кэша, а также специализированными структурами, например, буфером трансляции адресов (TLB) для быстрого преобразования виртуальных адресов — он опрашивается при каждом обращении к памяти и критичен для производительности систем с виртуальной адресацией.

Проблемы согласования между кэшами в многопроцессорных системах решаются протоколами когерентности. Крупные производители и эксперты (инженеры Intel, AMD, архитекторы серверных платформ) активно моделируют и оптимизируют эти механизмы для минимизации конфликтов и задержек.

Существуют три принципа организации взаимодействия кэшей разных уровней: инклюзивная, эксклюзивная и неэксклюзивная. Каждый подход имеет свои компромиссы между эффективностью использования ёмкости и скоростью доступа; например, эксклюзивная схема повышает общий объём полезной памяти в иерархии, что применяет AMD в ряде архитектур.

Уровни кэша процессора

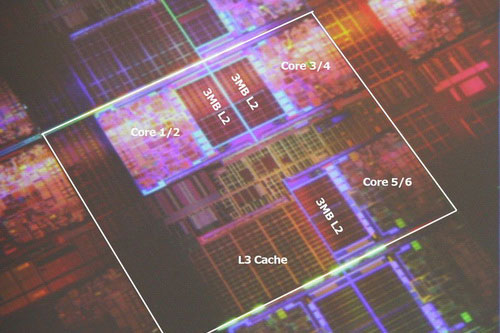

Кэш CPU обычно распределён по уровням: L1, L2, L3 (и реже L4). Каждый следующий уровень больше по объёму и медленнее по доступу. В многоядерных процессорах наблюдается сочетание приватных (на ядро) и общих (между ядрами) кэшей, что влияет на проектирование и масштабирование производительности.

- L1 — самый быстрый на уровне регистровый/локальный кэш; часто разделён на кэш инструкций и кэш данных. Обычно измеряется десятками килобайт и работает на частоте CPU.

- L2 — промежуточный уровень, крупнее L1 и медленнее; объёмы варьируются от сотен килобайт до нескольких мегабайт.

- L3 — общий для нескольких ядер в многоплатформных CPU; обеспечивает синхронизацию данных между L2 разных ядер; объёмы могут достигать нескольких десятков мегабайт.

- L4 — редко встречаемый в клиентских системах, применяется в высокопроизводительных серверах и мейнфреймах; часто реализуется как отдельная микросхема.

Ассоциативность кэша

Ассоциативность описывает, как строки памяти могут быть сопоставлены с линиями кэша. Чем выше ассоциативность, тем меньше конфликты при отображении адресов, но тем сложнее аппаратная логика и выше латентность поиска. Выбор оптимальной степени ассоциативности — баланс между скоростью и эффективностью использования пространства кэша. В отраслевой практике архитекторы проводят моделирование, опираясь на рабочие нагрузки (данные от команд архитектуры Intel/ARM и исследования ядра Linux), чтобы подобрать подходящую ассоциативность для конкретной микроархитектуры.

Кэширование внешних накопителей

Диски и оптические приводы также используют встроенные кэши для сглаживания последовательности операций и ускорения повторного доступа. Жёсткие диски могут иметь кэш-память от 1 Мбайт до нескольких сотен мегабайт; контроллеры используют её для оптимизации очередей команд (NCQ/TCQ).

Операционная система дополнительно использует свободную оперативную память в качестве диск-кэша, чтобы обслуживать частые запросы без обращения к медленным устройствам хранения. Эта стратегия особенно эффективна для операций чтения и для сгруппированных записей, когда можно объединить множество мелких операций в одну крупную.

Причины, почему кэширование внешних накопителей даёт эффект:

- скорость доступа к RAM значительно выше по сравнению с физическими носителями;

- механические накопители имеют высокую эффективность при последовательном чтении/записи, но проигрывают при случайных доступах;

- неоднородность частоты обращений: одни блоки читаются/записываются гораздо чаще — индексы, журналы, метаданные файловых систем.

Операционные системы применяют технику предзапроса (prefetch), считывая в кэш соседние блоки для улучшения последовательной пропускной способности. Главное ограничение — риск потери данных при отложенной записи в случае внезапного сбоя питания; для снижения рисков применяются периодические fsync, журналирование и принудительная синхронизация.

Программная реализация

Политика записи при кэшировании

При чтении выигрыш от кэша однозначен. При записи существуют компромиссы между производительностью и надёжностью. Две основные стратегии:

- Сквозная запись (write-through) — каждая запись одновременно отправляется и в кэш, и в основную память. Такой подход повышает надёжность, но увеличивает задержки записей.

- Отложенная запись (write-back) — изменения сначала фиксируются в кэше, а в основную память записываются позже (при вытеснении или по таймеру). Это даёт прирост производительности за счёт группировки операций, но требует механизмов отслеживания «грязных» (modified) строк и дополнительных мер по согласованию в мультипроцессорных системах.

Выбор политики зависит от критичности данных, требуемой надёжности и характера нагрузки. Эксперты по СУБД и файловым системам (включая команды разработки известных ОС) рекомендуют комбинировать write-back с журналированием и периодическим fsync для обеспечения консистентности при высоких нагрузках.

Алгоритм работы кэша с отложенной записью

Типичный жизненный цикл буфера в кэше с отложенной записью:

- поиск заголовка буфера в хеш-таблице по номеру блока;

- если буфер занят — ожидание освобождения;

- если не найден — взятие первого свободного буфера из списка;

- при отсутствии свободных буферов запускается алгоритм вытеснения;

- если выбранный буфер помечен как грязный, инициируется асинхронная запись в основную память;

- обновление хеш-таблицы и номера блока;

- чтение/модификация данных в буфере, пометка буфера как «грязного» при изменении и возврат буфера в список свободных.

Такая схема позволяет уменьшить количество обращений к внешнему хранилищу и повысить вероятность повторного использования прочитанных блоков несколькими процессами.

Алгоритм вытеснения

Выбор стратегии вытеснения — ключ к эффективности кэша. Основные алгоритмы:

- По времени:

- LRU (Least Recently Used) — вытесняется наименее недавно использованная запись;

- MRU (Most Recently Used) — вытесняется наиболее недавно использованная запись (полезно в специфических сценариях).

- По частоте:

- LFU (Least Frequently Used) — вытесняется наименее часто используемая запись;

- ARC (Adaptive Replacement Cache) — адаптивная гибридная стратегия, сочетающая достоинства LRU и LFU (известна из исследований IBM).

На практике выбор алгоритма основывается на характеристиках рабочей нагрузки: LRU эффективен при локальности ссылок по времени, LFU — при сильной повторяемости доступа к отдельным элементам. Сложные системы иногда используют гибридные и адаптивные схемы, которые динамически подстраиваются под паттерны доступа (этой теме посвящены публикации в профильных изданиях и исследованиях архитекторов процессоров).

Кэширование, выполняемое операционной системой

Операционная система организует диск-кэш из следующих компонентов:

- набор страниц в оперативной памяти, разделённых на буферы по размеру блока устройства;

- заголовки буферов, описывающие состояние каждой страницы;

- хеш-таблица для быстрого поиска буферов по номеру блока;

- списки свободных и занятых буферов.

Эта инфраструктура позволяет ОС эффективно обрабатывать множественные запросы к файлам и устройствам, минимизируя операции ввода-вывода и повышая общую отзывчивость системы.

Кэширование интернет-страниц

В сетевых сценариях веб-кэширование сохраняет часто запрашиваемые документы на промежуточных прокси или на клиенте, снижая трафик и улучшая скорость доставки. Управление кэшированием осуществляется через HTTP-заголовки (Cache-Control, ETag, Expires и др.).

Кэширование может быть реализовано как на стороне клиента, так и на стороне сервера (reverse proxy, CDN, кеширование на уровне CMS). Его применение существенно снижает нагрузку на исходный сервер при массовых посещениях, но ставит задачу своевременного обновления контента — изменения на сервере могут не сразу отразиться у клиентов, берущих данные из кэша.

Кэширование результатов работы

Многие приложения кэшируют промежуточные результаты — вычисленные индексы, предварительные отчёты, обработанные фрагменты данных — чтобы избежать повторных затрат на их получение. Это особенно важно в аналитических системах, поисковых движках и при обработке больших данных. Кэширование результатов повышает производительность, но требует политики инвалидирования (когда устаревшие результаты должны быть обновлены) и учета доступной памяти (оперативной или дисковой).

| Уровень | Типичный объём | Задержка (приблизительно) | Назначение | Ассоциативность (типично) |

|---|---|---|---|---|

| L1 | 16–128 КБ | 1–4 такта CPU | Кеш инструкций и данных, максимальная скорость | 4–8-ассоциативный |

| L2 | 128 КБ – 8 МБ | 5–20 тактов | Промежуточный буфер для ядра | 4–16-ассоциативный |

| L3 | 2–64 МБ | 15–50 тактов | Общий кэш для нескольких ядер, синхронизация | 8–16-ассоциативный / с большими линиями) |

| L4 | 64 МБ и более (высокопроизводительные системы) | 50–100+ тактов | Дополнительный кеш для серверов и мейнфреймов | чаще всего специальная архитектура |

- Рейтинг алгоритмов вытеснения (ориентировочно):

- LRU — высокий комфорт и предсказуемость для рабочих нагрузок с локальностью по времени;

- LFU — эффективен при повторяющихся горячих ключах;

- ARC — адаптивный и устойчивый при разнообразных паттернах доступа;

- MRU — полезен в специфических сценариях работы с потоками, где недавно использованные данные не повторяются.

Советы и Интересные факты о кэше

- Совет: для баз данных и серверных приложений настройка размера кэша часто важнее оптимизации кода — профилирование покажет узкие места быстрее, чем догадки.

- Факт: современные процессоры используют сложные гибридные стратегии предзагрузки (prefetching), которые основаны на анализе шаблонов доступа к памяти — это один из способов увеличить уровень попаданий без увеличения объёма кэша.

- Совет: при использовании write-back важно настроить периодическую синхронизацию и резервное питание контроллеров (BBU/UPS) для избежания потерь данных при сбоях.

- Факт: в распределённых системах кэширование на краю (edge caching, CDN) снижает задержки для пользователей по всему миру и уменьшает нагрузку на центральные ресурсы.

- Совет: тестируйте разные политики вытеснения (LRU vs LFU vs ARC) на реальной нагрузке — эмуляция рабочих сценариев даёт более точные результаты, чем теоретические предположения.

Часто задаваемые вопросы

Что такое кэш и зачем он нужен?

Кэш — это быстрый промежуточный буфер, в котором хранятся копии данных, наиболее часто запрашиваемых из медленного хранилища. Он нужен для уменьшения задержек доступа и повышения производительности системы.

Чем отличается write-through от write-back?

Write-through выполняет запись одновременно в кэш и основную память, что повышает надёжность, но снижает скорость. Write-back сначала записывает данные в кэш, а в основную память — позже, что повышает производительность, но требует механизма отслеживания и синхронизации «грязных» строк.

Какой алгоритм вытеснения кэша лучше?

Нет универсального лучшего алгоритма: LRU эффективен при локальности по времени, LFU — при частом повторном доступе к отдельным элементам, ARC адаптивен и сочетает преимущества обоих. Выбор зависит от характера рабочей нагрузки.

Как снизить риск потери данных при использовании кэша?

Для снижения рисков используйте периодическую принудительную синхронизацию (fsync), журналирование файловых систем, резервные источники питания для контроллеров и комбинируйте политику write-back с механизмами согласованности.