Кеш — це не просто технічний термін, це невидимий двигун, який прискорює роботу комп'ютерів, браузерів та серверів, знижуючи затримки та заощаджуючи ресурси. Уявіть, що потрібна інформація виявляється у вас під рукою ще до того, як ви її попросили - саме так діє добре спроектований кеш, будь то в процесорі, в дисковій підсистемі або в веб-браузері. У цій статті ми докладно розберемо поняття кеш/кеш (cache), його історію, архітектуру, алгоритми та практичні прийоми, які використовують провідні фахівці галузі — від інженерів Intel та AMD до розробників ядра Linux.

Історія

Термін cache вперше з'явився в комп'ютерній літературі наприкінці 1960-х років і швидко став загальновживаним. У контексті розвитку обчислювальної техніки він був введений під час опису покращень пам'яті для однієї з моделей сімейства System/360. Спочатку редактори шукали ємне позначення для концепції високошвидкісного буфера і зупинилися на слові cache, пізніше адаптованому в російськомовній практиці як кеш або кеш. З того часу концепція та термін пройшли значну еволюцію: від апаратних буферів у мейнфреймах до складних ієрархій рівнів кешу в сучасних багатоядерних CPU та розподілених кеш-шарів у хмарних системах.

Функціонування

Кеш — це проміжний буфер із прискореним доступом, що зберігає копії найбільш затребуваних даних із повільніших джерел. Основна ідея проста: надавати інформацію, що часто запитується, швидше, ніж зчитування її з основної пам'яті або віддаленого сервера. В результаті знижується середній час доступу та підвищується загальна продуктивність системи.

Структурно кеш складається з безлічі записів (рядків), кожна з яких містить копію блоку даних та ідентифікатор (тег), що вказує на джерело в основній пам'яті. При зверненні клієнт кеша (процесор, браузер, ОС) спершу перевіряє кеш. Якщо запис знайдено — це проникнення (hit), і дані повертаються швидко. Якщо ні – відбувається промах (miss), дані зчитуються з основного сховища і поміщаються в кеш.

При обмеженому об'ємі кешу необхідно вибирати записи для витіснення. Для цього застосовуються алгоритми витіснення, такі як LRU, LFU та ARC. Крім того, під час запису даних у кеш реалізуються різні політики синхронізації з основною пам'яттю - write-through (наскрізний запис) або write-back (відкладений запис). Також важливою є когерентність кешу в багатопроцесорних системах — протоколи на кшталт MESI/MOESI забезпечують узгодженість копій даних у різних кешах.

Приклад із повсякденної практики: веб-браузер перевіряє локальний дисковий кеш перед тим, як завантажити сторінку з віддаленого сервера — URL відіграє роль тега, а вміст сторінки — дані, що кешуються.

Апаратна реалізація

Кеш центрального процесора

З переходом процесорів до вищих тактових частот розрив між швидкістю CPU та підсистемою пам'яті став вузьким місцем. Апаратна кеш-пам'ять покликана згладити цей розрив, забезпечуючи доступ до даних із затримками, близькими до тактової частоти процесора.

Сучасні процесори оснащуються кількома рівнями кешу, а також спеціалізованими структурами, наприклад, буфером трансляції адрес (TLB) для швидкого перетворення віртуальних адрес - він опитується при кожному зверненні до пам'яті і критичний для продуктивності систем з віртуальною адресацією.

Проблеми узгодження між кешами у багатопроцесорних системах вирішуються протоколами когерентності. Великі виробники та експерти (інженери Intel, AMD, архітектори серверних платформ) активно моделюють та оптимізують ці механізми для мінімізації конфліктів та затримок.

Існують три принципи організації взаємодії кешів різних рівнів: інклюзивна, ексклюзивна та неексклюзивна. Кожен підхід має свої компроміси між ефективністю використання ємності та швидкістю доступу; наприклад, ексклюзивна схема підвищує загальний обсяг корисної пам'яті в ієрархії, що застосовує AMD у низці архітектур.

Рівні кешу процесора

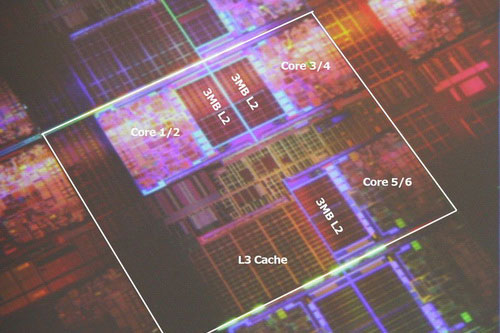

Кеш CPU зазвичай розподілено за рівнями: L1, L2, L3 (і рідше L4). Кожен наступний рівень більший за обсягом і повільніший за доступом. У багатоядерних процесорах спостерігається поєднання приватних (на ядро) та спільних (між ядрами) кешів, що впливає на проектування та масштабування продуктивності.

- L1 — найшвидший на рівні реєстровий/локальний кеш; часто поділено на кеш інструкцій та кеш даних. Зазвичай вимірюється десятками кілобайт та працює на частоті CPU.

- L2 — проміжний рівень, більший за L1 і повільніший; обсяги варіюються від сотень кілобайт до кількох мегабайт.

- L3 — загальний для кількох ядер у багатоплатформних CPU; забезпечує синхронізацію даних між L2 різних ядер; обсяги можуть досягати кількох десятків мегабайт.

- L4 — рідко зустрічається в клієнтських системах, застосовується у високопродуктивних серверах та мейнфреймах; часто реалізується як окрема мікросхема.

Асоціативність кешу

Асоціативність визначає, як рядки пам'яті можна порівняти з лініями кешу. Чим вища асоціативність, тим менші конфлікти при відображенні адрес, але тим складніша апаратна логіка і вища латентність пошуку. Вибір оптимального ступеня асоціативності – баланс між швидкістю та ефективністю використання простору кешу. У галузевій практиці архітектори проводять моделювання, спираючись на робочі навантаження (дані від команд архітектури Intel/ARM та дослідження ядра Linux), щоб підібрати відповідну асоціативність для конкретної мікроархітектури.

Кешування зовнішніх накопичувачів

Диски та оптичні приводи також використовують вбудовані кеші для згладжування послідовності операцій та прискорення повторного доступу. Жорсткі диски можуть мати кеш-пам'ять від 1 Мбайт до кількох сотень мегабайт; контролери використовують її для оптимізації черг команд (NCQ/TCQ).

Операційна система додатково використовує вільну оперативну пам'ять як диск-кеш, щоб обслуговувати часті запити без звернення до повільних пристроїв зберігання. Ця стратегія особливо ефективна для операцій читання та для згрупованих записів, коли можна об'єднати безліч дрібних операцій в одну велику.

Причини, чому кешування зовнішніх накопичувачів дає ефект:

- швидкість доступу до RAM значно вища порівняно з фізичними носіями;

- механічні накопичувачі мають високу ефективність при послідовному читанні/записі, але програють за випадкових доступів;

- неоднорідність частоти звернень: одні блоки читаються/записуються набагато частіше - індекси, журнали, метадані файлових систем.

Операційні системи застосовують техніку попереднього запиту (prefetch), зчитуючи в кеш сусідні блоки для поліпшення послідовної пропускної здатності. Головне обмеження – ризик втрати даних при відкладеному записі у разі раптового збою живлення; для зниження ризиків застосовуються періодичні fsync, журналування та примусова синхронізація.

Програмна реалізація

Політика запису під час кешування

При читанні виграш від кешу однозначний. При записі існують компроміси між продуктивністю та надійністю. Дві основні стратегії:

- Наскрізний запис (write-through) — кожен запис одночасно відправляється і в кеш, і в основну пам'ять. Такий підхід підвищує надійність, але підвищує затримки записів.

- Відкладений запис (write-back) — зміни спочатку фіксуються в кеші, а в основну пам'ять записуються пізніше (при витісненні або за таймером). Це дає приріст продуктивності за рахунок угруповання операцій, але вимагає механізмів відстеження «брудних» (modified) рядків та додаткових заходів для узгодження в мультипроцесорних системах.

Вибір політики залежить від критичності даних, необхідної надійності та характеру навантаження. Експерти з СУБД та файлових систем (включаючи команди розробки відомих ОС) рекомендують комбінувати write-back з журналуванням та періодичним fsync для забезпечення консистентності при високих навантаженнях.

Алгоритм роботи кешу з відкладеним записом

Типовий життєвий цикл буфера в кеші з відкладеним записом:

- пошук заголовка буфера в хеш-таблиці за номером блоку;

- якщо буфер зайнятий — очікування на звільнення;

- якщо не знайдено — взяття першого вільного буфера зі списку;

- за відсутності вільних буферів запускається алгоритм витіснення;

- якщо вибраний буфер позначений як брудний, ініціюється асинхронний запис в основну пам'ять;

- оновлення хеш-таблиці та номера блоку;

- читання/модифікація даних у буфері, позначка буфера як «брудного» при зміні та повернення буфера до списку вільних.

Така схема дозволяє зменшити кількість звернень до зовнішнього сховища та підвищити ймовірність повторного використання прочитаних блоків кількома процесами.

Алгоритм витіснення

Вибір стратегії витіснення є ключем до ефективності кешу. Основні алгоритми:

- За часом:

- LRU (Least Recently Used) — витісняється найменш недавно використаний запис;

- MRU (Most Recently Used) — витісняється запис нещодавно використаний (корисно в специфічних сценаріях).

- За частотою:

- LFU (Least Frequently Used) — витісняється найменш часто використовуваний запис;

- ARC (Adaptive Replacement Cache) — адаптивна гібридна стратегія, що поєднує переваги LRU та LFU (відома з досліджень IBM).

На практиці вибір алгоритму ґрунтується на характеристиках робочого навантаження: LRU ефективний при локальності посилань за часом, LFU - при сильній повторюваності доступу до окремих елементів. Складні системи іноді використовують гібридні та адаптивні схеми, які динамічно підлаштовуються під патерни доступу (цій темі присвячені публікації у профільних виданнях та дослідженнях архітекторів процесорів).

Кешування, яке виконує операційна система

Операційна система організує диск-кеш із наступних компонентів:

- набір сторінок в оперативній пам'яті, розділених на буфери за розміром блоку пристрою;

- заголовки буферів, що описують стан кожної сторінки;

- хеш-таблиця для швидкого пошуку буферів за номером блоку;

- списки вільних та зайнятих буферів.

Ця інфраструктура дозволяє ОС ефективно обробляти множинні запити до файлів та пристроїв, мінімізуючи операції вводу-виводу та підвищуючи загальну чуйність системи.

Кешування інтернет-сторінок

У мережних сценаріях веб-кешування зберігає документи, що часто запитуються, на проміжних проксі або на клієнті, знижуючи трафік і покращуючи швидкість доставки. Керування кешуванням здійснюється через HTTP-заголовки (Cache-Control, ETag, Expires та ін.).

Кешування може бути реалізоване як на стороні клієнта, так і на стороні сервера (reverse proxy, CDN, кешування на рівні CMS). Його застосування суттєво знижує навантаження на вихідний сервер при масових відвідуваннях, але ставить завдання своєчасного оновлення контенту — зміни на сервері можуть не відразу позначитися у клієнтів, які беруть дані з кешу.

Кешування результатів роботи

Багато програм кешують проміжні результати — обчислені індекси, попередні звіти, оброблені фрагменти даних — щоб уникнути повторних витрат на їх отримання. Це особливо важливо в аналітичних системах, пошукових двигунах та при обробці великих даних. Кешування результатів підвищує продуктивність, але вимагає політики інвалідування (коли застарілі результати мають бути оновлені) та обліку доступної пам'яті (оперативної чи дискової).

| Рівень | Типовий об'єм | Затримка (приблизно) | Призначення | Асоціативність (типово) |

|---|---|---|---|---|

| L1 | 16–128 КБ | 1–4 такти CPU | Кеш інструкцій та даних, максимальна швидкість | 4–8-асоціативний |

| L2 | 128 КБ – 8 МБ | 5–20 тактів | Проміжний буфер для ядра | 4–16-асоціативний |

| L3 | 2–64 МБ | 15–50 тактів | Спільний кеш для кількох ядер, синхронізація | 8–16-асоціативний / з великими лініями) |

| L4 | 64 МБ і більше (високопродуктивні системи) | 50–100+ тактів | Додатковий кеш для серверів та мейнфреймів | найчастіше спеціальна архітектура |

- Рейтинг алгоритмів витіснення (орієнтовно):

- LRU — високий комфорт та передбачуваність для робочих навантажень з локальністю за часом;

- LFU — ефективний при гарячих ключах, що повторюються;

- ARC - адаптивний і стійкий при різноманітних патернах доступу;

- MRU — корисний у специфічних сценаріях роботи з потоками, де нещодавно використані дані не повторюються.

Поради та Цікаві факти про кеш

- Рада: для баз даних і серверних програм налаштування розміру кешу часто важливіше оптимізації коду - профіль покаже вузькі місця швидше, ніж здогадки.

- Факт: сучасні процесори використовують складні гібридні стратегії передзавантаження (prefetching), які ґрунтуються на аналізі шаблонів доступу до пам'яті – це один із способів збільшити рівень влучень без збільшення обсягу кешу.

- Рада: при використанні write-back важливо налаштувати періодичну синхронізацію та резервне живлення контролерів (BBU/UPS) для уникнення втрат даних при збоях.

- Факт: у розподілених системах кешування на краю (edge caching, CDN) знижує затримки для користувачів по всьому світу та зменшує навантаження на центральні ресурси.

- Рада: тестуйте різні політики витіснення (LRU vs LFU vs ARC) на реальному навантаженні — емуляція робочих сценаріїв дає більш точні результати, ніж теоретичні припущення.

Часті питання

Що таке кеш і навіщо він мені потрібен?

Кеш - це швидкий буфер, який зберігає копії даних, які найчастіше запитуються з повільного сховища. Потрібно зменшити затримки доступу та покращити продуктивність систем

Яка різниця між записом-наскрізним і зворотним?

Запис-через одночасно записує в кеш і основну пам'ять, що підвищує надійність, але знижує швидкість. Write-back спочатку записує дані в кеш, а потім в основну пам'ять пізніше, що підвищує продуктивність, але вимагає механізму для відстеження і синхронізації "брудних" рядкі

Яка найкраща поведінка кешування?

Немає універсальної найкращої поведінки: LRU ефективний у локалізований час, LFU - при частому повторному доступі до окремих предметів, ARC є адаптивним і поєднує переваги обох. Залежить від характеру вашого робочого навантаженн

Як зменшити ризик втрати даних при використанні кешу?

Використовуйте fsync, журналювання файлової системи, резервне живлення для контролерів, а також поєднуйте зворотний запис із механізмами узгодженості для зменшення ризикі